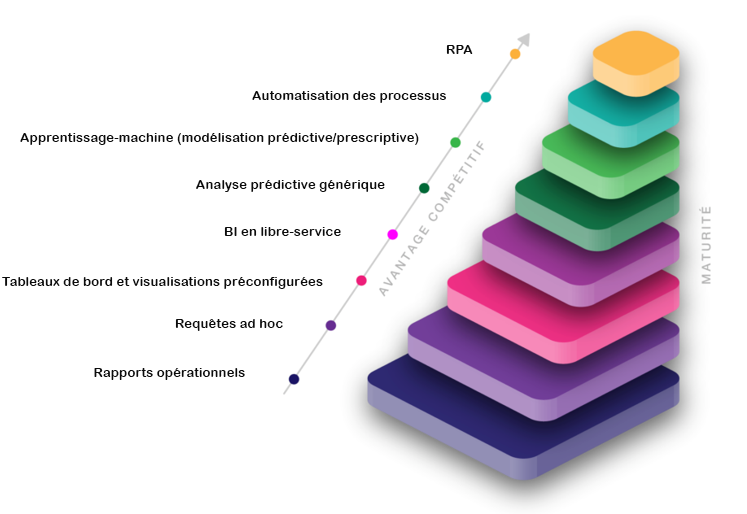

L’analyse prédictive représente un bond considérable dans la complexité car elle s’attaque à l’incertitude du futur. Elle se propose, à l’aide d’outils mathématiques complexes, de transformer l’information obtenue jusqu’à présent, en savoir. Ce savoir, par le calcul de la probabilité d’occurrence d’un évènement dans le futur, nous permet de prendre des décisions éduquées. L’analyse prédictive permet de lever une partie du voile de l’incertitude du futur et ainsi de prendre la meilleure décision éduquée possible. C’est le domaine de la modélisation prédictive, du Machine Learning et du Deep Learning.

L’analyse prescriptive est mathématiquement identique à l'analyse prédictive mais inversée dans le temps. Si l'analyse prédictive nous apprend, pour un univers présent donné, la probabilité d’occurrence d’un événement dans le futur, l'analyse prescriptive nous indique ce qu'il faut que nous changions dans notre univers présent afin d’augmenter la probabilité d’occurrence d’un évènement donné dans le futur.

Modélisation prédictive statique

Un modèle est une équation mathématique qui comporte des paramètres. Chaque paramètre représente une corrélation entre deux variables. Dans un modèle classique, ou statique, les paramètres sont figés et donc ne varient pas avec le temps. Cependant l’univers lui évolue, les corrélations changent et les modèles deviennent donc obsolètes avec le temps. Il est donc nécessaire de les recalculer régulièrement.

Les modèles statiques offrent cependant l’avantage de pouvoir expliquer l’origine d’une prédiction, ce qui est utile, et parfois obligatoire, dans des industries régulées telles que banque et finance.

Modélisation prédictive dynamique - Machine Learning

Afin de contrer l’obsolescence des modèles prédictifs avec le temps, il a été rendu possible le recalcul automatique des paramètres avec l’ajout de nouvelles observations. Ce recalcul se fait grâce a l’emploi de la validation croisée et grâce à une régularisation pilotée par des hyperparamètres. Les modèles prédictifs conçus en apprentissage automatique ou Machine Learning s’adaptent automatiquement au fur et a mesure de l’adjonction de nouvelles observations. Cela apporte un gain considérable en efficacité, en temps et en précision.

Réseau neuronal / Deep Learning

Les réseaux de neurones sont apparus dans les années 60 et n’ont cesse de se perfectionner. Conçus pour imiter le fonctionnement d’un cerveau humain ils sont composés de « neurones » ou « nodes » a travers lesquels passent un flux de données, contrôlé par des fonctions d’activation. Les neurones sont disposés en couches. Lorsqu’un réseau comporte plus de 7 couches on parle de réseau de neurones profond et donc d’apprentissage profond ou Deep Learning.

Ces réseaux sont aujourd’hui largement utilisés, entre autres dans des applications complexes de reconnaissance d’images et de sons, de reconnaissance vocale et d’écriture.